Una guía para principiantes sobre la recopilación de datos de IA

Elección de la empresa de recopilación de datos de IA para su proyecto de IA / ML

Introducción

A partir de ahora, estamos avanzando por el camino correcto con importantes avances en todas las industrias con la ayuda de la inteligencia artificial. Si tomas la atención médica, por ejemplo, los sistemas de inteligencia artificial acompañados de modelos de aprendizaje automático están ayudando a los expertos a comprender mejor el cáncer y a encontrar tratamientos para él. Los trastornos neurológicos y las preocupaciones como el trastorno de estrés postraumático se tratan con la ayuda de la IA. Las vacunas se están desarrollando a un ritmo rápido gracias a las simulaciones y los ensayos clínicos impulsados por la IA.

No solo el cuidado de la salud, cada industria o segmento que toca la IA está siendo revolucionado. Los vehículos autónomos, las tiendas de conveniencia inteligentes, los dispositivos portátiles como FitBit e incluso las cámaras de nuestros teléfonos inteligentes pueden capturar mejores imágenes de nuestros rostros con IA.

Gracias a las innovaciones que se están produciendo en el espacio de la IA, las empresas están entrando en el espectro con varios casos de uso y soluciones. Debido a esto, se prevé que el mercado global de IA alcance un valor de mercado de alrededor de $ 267 mil millones para fines de 2027. Además, alrededor del 37% de las empresas ya están implementando soluciones de IA en sus procesos y productos.

Más interesante aún, cerca del 77% de los productos y servicios que usamos hoy en día funcionan con inteligencia artificial. Con el concepto de tecnología aumentando significativamente en las verticales, ¿cómo se las arreglan las empresas para hacer lo imposible con la IA?

¿Cómo nos hacen creer los chatbots que estamos hablando con otro humano del otro lado?

Si observa la respuesta a cada pregunta, se reduce a un solo elemento: DATOS. Los datos se encuentran en el centro de todas las operaciones y procesos específicos de la IA. Son los datos los que ayudan a las máquinas a comprender conceptos, procesar entradas y ofrecer resultados precisos.

Todas las principales soluciones de IA que existen son todos productos de un proceso crucial que llamamos recopilación de datos o adquisición de datos o datos de entrenamiento de IA.

Esta extensa guía tiene como objetivo ayudarlo a comprender qué es y por qué es importante.

¿Qué es la recopilación de datos de IA?

Las máquinas no tienen mente propia. La ausencia de este concepto abstracto los hace desprovistos de opiniones, hechos y capacidades como el razonamiento, la cognición y más. Son simplemente cajas o dispositivos inamovibles que ocupan espacio. Para convertirlos en medios poderosos, necesita algoritmos y, lo que es más importante, datos.

Cada uno de los productos o soluciones habilitados para IA que utilizamos hoy en día y los resultados que ofrecen se derivan de años de capacitación, desarrollo y optimización. Desde dispositivos que ofrecen rutas de navegación hasta esos sistemas complejos que predicen fallas de equipos con días de anticipación, cada entidad ha pasado por años de capacitación en inteligencia artificial para poder entregar resultados con precisión.

Recopilación de datos de IA es el paso preliminar en el proceso de desarrollo de IA que desde el principio determina qué tan efectivo y eficiente sería un sistema de IA. Es el proceso de obtener conjuntos de datos relevantes de una miríada de fuentes lo que ayudará a los modelos de IA a procesar mejor los detalles y producir resultados significativos.

Tipos de datos de entrenamiento de IA en aprendizaje automático

Ahora, la recopilación de datos de IA es un término general. Los datos en este espacio pueden significar cualquier cosa. Puede ser texto, secuencias de video, imágenes, audio o una combinación de todos estos. En definitiva, todo lo que sea útil para que una máquina realice su tarea de aprendizaje y optimización de resultados son los datos. Para brindarle más información sobre los diferentes tipos de datos, aquí hay una lista rápida:

Los conjuntos de datos pueden provenir de una fuente estructurada o no estructurada. Para los no iniciados, los conjuntos de datos estructurados son aquellos que tienen un significado y formato explícitos. Son fácilmente comprensibles para las máquinas. Sin estructura, por otro lado, son detalles en conjuntos de datos que están por todas partes. No siguen una estructura o formato específico y requieren la intervención humana para extraer información valiosa de dichos conjuntos de datos.

Datos de texto

Una de las formas de datos más abundantes y destacadas. Los datos de texto se pueden estructurar en forma de información de bases de datos, unidades de navegación GPS, hojas de cálculo, dispositivos médicos, formularios y más. El texto no estructurado puede ser encuestas, documentos escritos a mano, imágenes de texto, respuestas por correo electrónico, comentarios de redes sociales y más.

Datos de audio

Los conjuntos de datos de audio ayudan a las empresas a desarrollar mejores chatbots y sistemas, diseñar mejores asistentes virtuales y más. También ayudan a las máquinas a comprender los acentos y las pronunciaciones de las diferentes formas en que se puede hacer una sola pregunta o consulta.

Datos de imagen

Las imágenes son otro tipo de conjunto de datos destacado que se utiliza para diversos fines. Desde vehículos autónomos y aplicaciones como Google Lens hasta reconocimiento facial, las imágenes ayudan a los sistemas a encontrar soluciones perfectas.

Datos de video

Los videos son conjuntos de datos más detallados que permiten a las máquinas comprender algo en profundidad. Los conjuntos de datos de video provienen de visión por computadora, imágenes digitales y más.

¿Cómo recopilar datos para un aprendizaje automático?

Entonces, ¿cómo obtiene sus datos? ¿Qué datos necesitas y cuántos de ellos? ¿Cuáles son las múltiples fuentes para obtener datos relevantes?

Las empresas evalúan el nicho y el propósito de sus modelos de AA y trazan formas potenciales de obtener conjuntos de datos relevantes. La definición del tipo de datos necesarios resuelve una gran parte de su preocupación sobre el suministro de datos. Para darle una mejor idea, existen diferentes canales, avenidas, fuentes o medios para la recolección de datos:

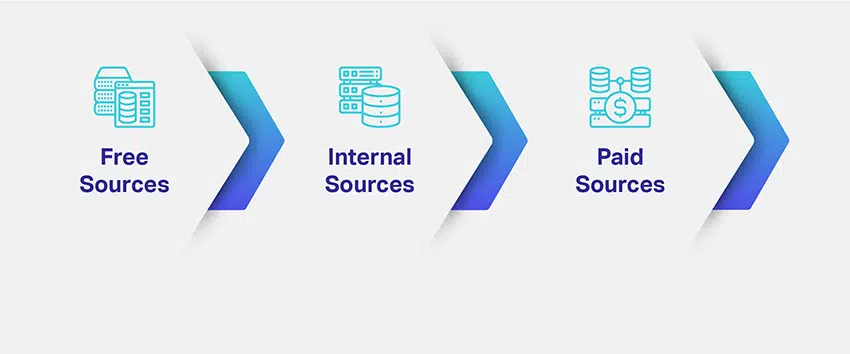

Fuentes libres

Como sugiere el nombre, estos son recursos que ofrecen conjuntos de datos para fines de entrenamiento de IA de forma gratuita. Las fuentes gratuitas pueden ser cualquier cosa, desde foros públicos, motores de búsqueda, bases de datos y directorios hasta portales gubernamentales que mantienen archivos de información a lo largo de los años.

Si no desea esforzarse demasiado en obtener conjuntos de datos gratuitos, existen sitios web y portales dedicados como el de Kaggle, recursos de AWS, bases de datos UCI y más que le permitirán explorar diversos

categorías y descargue los conjuntos de datos necesarios de forma gratuita.

Recursos internos

Aunque los recursos gratuitos parecen ser opciones convenientes, existen varias limitaciones asociadas con ellos. En primer lugar, no siempre puede estar seguro de que encontrará conjuntos de datos que coincidan exactamente con sus requisitos. Incluso si coinciden, los conjuntos de datos pueden ser irrelevantes en términos de líneas de tiempo.

Si su segmento de mercado es relativamente nuevo o inexplorado, no habría muchas categorías o categorías relevantes.

conjuntos de datos para que los descargue también. Para evitar las deficiencias preliminares con recursos gratuitos, hay

Existe otro recurso de datos que actúa como un canal para que usted genere conjuntos de datos más relevantes y contextuales.

Son sus fuentes internas, como bases de datos de CRM, formularios, clientes potenciales de marketing por correo electrónico, puntos de contacto definidos por productos o servicios, datos de usuario, datos de dispositivos portátiles, datos de sitios web, mapas de calor, conocimientos de redes sociales y más. Usted define, configura y mantiene estos recursos internos. Por lo tanto, puede estar seguro de su credibilidad, relevancia y actualidad.

Recursos pagados

No importa lo útiles que suenen, los recursos internos también tienen su parte justa de complicaciones y limitaciones. Por ejemplo, la mayor parte del enfoque de su grupo de talentos se destinará a optimizar los puntos de contacto de datos. Además, la coordinación entre sus equipos y recursos también debe ser impecable.

Para evitar más contratiempos como estos, ha pagado fuentes. Son servicios que le ofrecen los conjuntos de datos más útiles y contextuales para sus proyectos y garantizan que los obtenga constantemente cuando los necesite.

La primera impresión que la mayoría de nosotros tenemos sobre las fuentes de pago o los proveedores de datos es que son caras. Sin embargo,

cuando haces los cálculos, solo son baratos a largo plazo. Gracias a sus redes expansivas y metodologías de abastecimiento de datos, podrá recibir conjuntos de datos complejos para sus proyectos de inteligencia artificial, independientemente de cuán inverosímiles sean.

Para darle un esquema detallado de las diferencias entre las tres fuentes, aquí hay una tabla elaborada:

| Recursos Gratuitos | Recursos internos | Recursos pagados |

|---|---|---|

| Los conjuntos de datos están disponibles de forma gratuita. | Los recursos internos también podrían ser gratuitos dependiendo de sus gastos operativos. | Usted paga a un proveedor de datos para que le proporcione conjuntos de datos relevantes. |

| Múltiples recursos gratuitos disponibles en línea para descargar conjuntos de datos preferidos. | Obtiene datos personalizados según sus necesidades de entrenamiento en IA. | Obtiene datos definidos de forma personalizada de forma coherente durante el tiempo que necesite. |

| Debe trabajar manualmente en la compilación, la curación, el formateo y la anotación de conjuntos de datos. | Incluso puede modificar sus puntos de contacto de datos para generar conjuntos de datos con la información requerida. | Los conjuntos de datos de los proveedores están preparados para el aprendizaje automático. Es decir, están anotados y vienen con garantía de calidad. |

| Tenga cuidado con las restricciones de licencia y cumplimiento de los conjuntos de datos que descarga. | Los recursos internos se vuelven riesgosos si tiene un tiempo limitado para comercializar su producto. | Puede definir sus plazos y hacer que los conjuntos de datos se entreguen en consecuencia. |

¿Cómo afectan los datos incorrectos a sus ambiciones de IA?

Enumeramos los tres recursos de datos más comunes por el motivo de que tendrá una idea sobre cómo abordar la recopilación y el abastecimiento de datos. Sin embargo, en este punto, también es esencial comprender que su decisión podría decidir invariablemente el destino de su solución de IA.

De manera similar a cómo los datos de entrenamiento de IA de alta calidad pueden ayudar a su modelo a entregar resultados precisos y oportunos, los datos de entrenamiento deficientes también pueden romper sus modelos de IA, sesgar los resultados, introducir sesgos y ofrecer otras consecuencias indeseables.

Pero, ¿por qué sucede esto? ¿No se supone que hay datos para entrenar y optimizar su modelo de IA? Honestamente no. Entendamos esto más a fondo.

Datos incorrectos: ¿qué son?

La diferencia entre los datos no estructurados y los malos es que los conocimientos sobre los datos no estructurados están por todas partes. Pero, en esencia, podrían ser útiles independientemente. Al dedicar más tiempo, los científicos de datos aún podrían extraer información relevante de conjuntos de datos no estructurados. Sin embargo, ese no es el caso de los datos incorrectos. Estos conjuntos de datos contienen información o conocimientos limitados o nulos que sean valiosos o relevantes para su proyecto de IA o sus propósitos de capacitación.

Por lo tanto, cuando obtiene sus conjuntos de datos de recursos gratuitos o tiene puntos de contacto de datos internos poco establecidos, es muy probable que descargue o genere datos incorrectos. Cuando sus científicos trabajan con datos incorrectos, no solo está desperdiciando horas humanas, sino que también está impulsando el lanzamiento de su producto.

Si aún no tiene claro lo que los datos incorrectos pueden afectar a sus ambiciones, aquí hay una lista rápida:

- Pasas innumerables horas obteniendo datos incorrectos y desperdicias horas, esfuerzo y dinero en recursos.

- Los datos incorrectos pueden traerle problemas legales, si pasan desapercibidos y pueden reducir la eficiencia de su IA

. - Cuando lleva su producto capacitado sobre datos incorrectos en vivo, afecta la experiencia del usuario

- Los datos incorrectos podrían sesgar los resultados y las inferencias, lo que podría generar aún más reacciones negativas.

Entonces, si se pregunta si hay una solución para esto, en realidad la hay.

Proveedores de datos de entrenamiento de IA al rescate

Todo lo que tienes que hacer es asimilar los datos y entrenar tus modelos de IA para que sean perfectos. Dicho esto, estamos seguros de que su próxima pregunta es sobre los gastos relacionados con la colaboración con los proveedores de datos. Entendemos que algunos de ustedes ya están trabajando en un presupuesto mental y eso es exactamente hacia donde nos dirigimos también.

Factores a considerar al elaborar un presupuesto efectivo para su proyecto de recopilación de datos

El entrenamiento de IA es un enfoque sistemático y es por eso que el presupuesto se convierte en una parte integral de él. Se deben considerar factores como el RoI, la precisión de los resultados, las metodologías de capacitación y más antes de invertir una gran cantidad de dinero en el desarrollo de la IA. Muchos gerentes de proyectos o dueños de negocios tienen problemas en esta etapa. Toman decisiones apresuradas que traen cambios irreversibles en su proceso de desarrollo de productos, lo que finalmente los obliga a gastar más.

Sin embargo, esta sección le brindará la información adecuada. Cuando se sienta a trabajar en el presupuesto para el entrenamiento de IA, tres cosas o factores son inevitables.

Veamos cada uno en detalle.

El volumen de datos que necesita

Hemos dicho todo el tiempo que la eficiencia y precisión de su modelo de IA depende de cuánto esté entrenado. Esto significa que cuanto mayor sea el volumen de conjuntos de datos, mayor será el aprendizaje. Pero esto es muy vago. Para poner un número a esta noción, Dimensional Research publicó un informe que reveló que las empresas necesitan un mínimo de 100,000 conjuntos de datos de muestra para entrenar sus modelos de IA.

Por 100,000 conjuntos de datos, nos referimos a 100,000 conjuntos de datos relevantes y de calidad. Estos conjuntos de datos deben tener todos los atributos, anotaciones y conocimientos esenciales necesarios para que sus algoritmos y modelos de aprendizaje automático procesen la información y ejecuten las tareas previstas.

Con esta es una regla general, entendamos mejor que el volumen de datos que necesita también depende de otro factor intrincado que es el caso de uso de su empresa. Lo que pretende hacer con su producto o solución también decide cuántos datos necesita. Por ejemplo, una empresa que crea un motor de recomendaciones tendría requisitos de volumen de datos diferentes a los de una empresa que crea un chatbot.

Estrategia de precios de datos

Cuando haya terminado de determinar la cantidad de datos que realmente necesita, debe trabajar a continuación en una estrategia de precios de datos. Esto, en términos simples, significa cómo pagaría por los conjuntos de datos que obtenga o genere.

En general, estas son las estrategias de precios convencionales que se siguen en el mercado:

| Tipo de datos | Estrategia para colocar precios |

|---|---|

| Precio por archivo de imagen individual | |

| Precio por segundo, minuto, hora o fotograma individual | |

| Precio por segundo, minuto u hora | |

| Precio por palabra u oración |

Pero espera. Esta es nuevamente una regla de oro. El costo real de adquirir conjuntos de datos también depende de factores como:

- El segmento de mercado único, la demografía o la geografía de donde se deben obtener los conjuntos de datos.

- La complejidad de su caso de uso

- ¿Cuántos datos necesitas?

- Tu tiempo para comercializar

- Cualquier requisito personalizado y más

Si observa, sabrá que el costo de adquirir grandes cantidades de imágenes para su proyecto de IA podría ser menor, pero si tiene demasiadas especificaciones, los precios podrían dispararse.

Tus estrategias de abastecimiento

Esto es complicado. Como vio, existen diferentes formas de generar o obtener datos para sus modelos de IA. El sentido común dicta que los recursos gratuitos son los mejores, ya que puede descargar los volúmenes necesarios de conjuntos de datos de forma gratuita y sin complicaciones.

En este momento, también parecería que las fuentes pagas son demasiado caras. Pero aquí es donde se agrega una capa de complicación. Cuando obtiene conjuntos de datos de recursos gratuitos, está dedicando una cantidad adicional de tiempo y esfuerzo a limpiar sus conjuntos de datos, compilarlos en el formato específico de su negocio y luego anotarlos individualmente. Está incurriendo en costos operativos en el proceso.

Con las fuentes de pago, el pago es único y también tiene a mano conjuntos de datos listos para la máquina en el momento que lo necesite. La rentabilidad es muy subjetiva aquí. Si cree que puede dedicar tiempo a anotar conjuntos de datos gratuitos, puede presupuestar en consecuencia. Y si cree que su competencia es feroz y con un tiempo de comercialización limitado, puede crear un efecto dominó en el mercado, debe preferir las fuentes pagas.

El presupuesto se trata de desglosar los detalles y definir claramente cada fragmento. Estos tres factores deberían servirle como hoja de ruta para su proceso de presupuestación de capacitación en IA en el futuro.

¿Está ahorrando en gastos con la adquisición de datos interna?

Sabemos que todavía tiene dudas sobre las fuentes pagas y es por eso que esta sección aclarará su escepticismo al respecto y arrojará luz sobre los costos ocultos involucrados en la generación de datos interna.

¿Es costosa la adquisición de datos interna?

¡Sí lo es!

Ahora, aquí hay una respuesta elaborada. El gasto es todo lo que gasta. Mientras discutíamos los recursos gratuitos, revelamos que gasta dinero, tiempo y esfuerzo en el proceso. Esto también se aplica a la adquisición de datos interna.

En última instancia, terminaría gastando en pagar a sus empleados, científicos de datos, anotadores, profesionales de control de calidad y más. También gastará en suscripciones para herramientas de anotación y

mantenimiento de CMS, CRM y otros gastos de infraestructura.

Además, es probable que los conjuntos de datos tengan problemas de sesgo y precisión, por lo que debe ordenarlos manualmente. Y si tiene un problema de desgaste en su equipo de datos de entrenamiento de IA, tendrá que gastar en reclutar nuevos miembros, orientarlos en sus procesos, capacitarlos para usar sus herramientas y más.

Terminará gastando más de lo que eventualmente ganaría a largo plazo. También hay gastos de anotación. En cualquier momento dado, el costo total incurrido para trabajar con datos internos es:

Costo incurrido = Número de anotadores * Costo por anotador + Costo de plataforma

Si su calendario de entrenamiento de IA está programado para meses, imagine los gastos en los que incurriría constantemente. Entonces, ¿es esta la solución ideal para los problemas de adquisición de datos o hay alguna alternativa?

Beneficios de un proveedor de servicios de recopilación de datos de IA de extremo a extremo

Existe una solución confiable para este problema y existen formas mejores y menos costosas de adquirir datos de entrenamiento para sus modelos de IA. Los llamamos proveedores de servicios de datos de capacitación o proveedores de datos.

Son empresas como Shaip que se especializan en ofrecer conjuntos de datos de alta calidad basados en sus necesidades y requisitos únicos. Eliminan todas las molestias a las que se enfrenta en la recopilación de datos, como obtener conjuntos de datos relevantes, limpiarlos, compilarlos y anotarlos, y más, y le permiten concentrarse solo en optimizar sus modelos y algoritmos de IA. Al colaborar con los proveedores de datos, se concentra en las cosas que importan y en aquellas sobre las que tiene control.

Además, también eliminará todas las molestias asociadas con la obtención de conjuntos de datos de recursos internos y gratuitos. Para que comprenda mejor las ventajas de los proveedores de datos de un extremo a otro, aquí hay una lista rápida:

- Los proveedores de servicios de datos de capacitación comprenden completamente su segmento de mercado, casos de uso, datos demográficos y otros detalles para obtener los datos más relevantes para su modelo de IA.

- Tienen la capacidad de obtener diversos conjuntos de datos que consideren adecuados para su proyecto, como imágenes, videos, texto, archivos de audio o todos estos.

- Los proveedores de datos limpian los datos, los estructuran y los etiquetan con atributos y conocimientos que las máquinas y los algoritmos necesitan para aprender y procesar. Este es un esfuerzo manual que requiere una atención meticulosa a los detalles y al tiempo.

- Tiene expertos en la materia que se encargan de anotar información crucial. Por ejemplo, si el caso de uso de su producto se encuentra en el espacio de la atención médica, no puede obtener anotaciones de un profesional que no sea de la salud y esperar resultados precisos. Con los proveedores de datos, ese no es el caso. Trabajan con pymes y se aseguran de que los veteranos de la industria anoten correctamente sus datos de imágenes digitales.

- También se encargan de la desidentificación de los datos y se adhieren a HIPAA u otros cumplimientos y protocolos específicos de la industria para que usted se mantenga alejado de todas y cada una de las complicaciones legales.

- Los proveedores de datos trabajan incansablemente para eliminar el sesgo de sus conjuntos de datos, lo que garantiza que tenga resultados e inferencias objetivos.

- También recibirá los conjuntos de datos más recientes en su nicho para que sus modelos de IA estén optimizados para una eficiencia óptima.

- También es fácil trabajar con ellos. Por ejemplo, los cambios repentinos en los requisitos de datos se les pueden comunicar y obtendrían sin problemas los datos apropiados en función de las necesidades actualizadas.

Con estos factores, creemos firmemente que ahora comprende cuán rentable y simple es colaborar con proveedores de datos de capacitación. Con este conocimiento, averigüemos cómo puede elegir el proveedor de datos más ideal para su proyecto de IA.

Abastecimiento de conjuntos de datos relevantes

Comprenda su mercado, casos de uso, datos demográficos para obtener conjuntos de datos recientes, ya sean imágenes, videos, texto o audio.

Limpiar datos relevantes

Estructurar y etiquetar los datos con atributos y conocimientos que comprendan las máquinas y los algoritmos.

Sesgo de datos

Elimine el sesgo de los conjuntos de datos, asegurándose de tener resultados e inferencias objetivos.

Anotación de datos

Los expertos en la materia de dominios específicos se encargan de anotar piezas cruciales de información.

Desidentificación de datos

Adhiérase a HIPAA, GDPR u otros protocolos y cumplimientos específicos de la industria para eliminar las complejidades legales.

Cómo elegir la empresa de recopilación de datos de IA adecuada

Elegir una empresa de recopilación de datos de IA no es tan complicado ni requiere tanto tiempo como recopilar datos de recursos gratuitos. Solo hay unos pocos factores simples que debe considerar y luego estrechar la mano para una colaboración.

Cuando comienza a buscar un proveedor de datos, asumimos que ha seguido y considerado todo lo que hemos discutido hasta ahora. Sin embargo, aquí hay un resumen rápido:

- Tiene un caso de uso bien definido en mente

- Su segmento de mercado y los requisitos de datos están claramente establecidos

- Tu presupuesto está a punto

- Y tienes una idea del volumen de datos que necesitas

Con estos elementos marcados, entendamos cómo puede buscar un proveedor de servicios de datos de entrenamiento ideal.

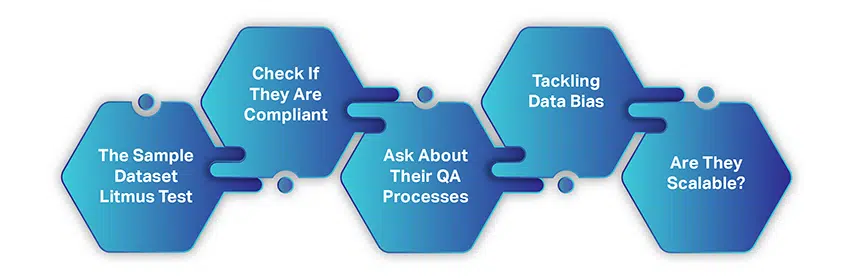

La prueba de tornasol del conjunto de datos de muestra

Antes de firmar un contrato a largo plazo, siempre es una buena idea conocer en detalle a un proveedor de datos. Por lo tanto, comience su colaboración con el requisito de un conjunto de datos de muestra por el que pagará.

Este podría ser un pequeño volumen de conjunto de datos para evaluar si han entendido sus requisitos, si tienen implementadas las estrategias de adquisición adecuadas, sus procedimientos de colaboración, transparencia y más. Teniendo en cuenta el hecho de que estaría en contacto con varios proveedores en este momento, esto le ayudará a ahorrar tiempo al decidir un proveedor y determinar quién es, en última instancia, más adecuado para sus necesidades.

Compruebe si cumplen

De forma predeterminada, la mayoría de los proveedores de servicios de datos de formación cumplen con todos los requisitos y protocolos reglamentarios. Sin embargo, para estar seguro, pregunte acerca de sus normativas y políticas y luego reduzca su selección.

Pregunte por sus procesos de control de calidad

El proceso de recopilación de datos en sí mismo es sistemático y en capas. Existe una metodología lineal que se implementa. Para tener una idea de cómo operan, pregunte sobre sus procesos de control de calidad y averigüe si los conjuntos de datos que obtienen y anotan pasan por controles de calidad y auditorías. Esto te dará una

idea de si los entregables finales que recibiría están listos para la máquina.

Abordar el sesgo de datos

Solo un cliente informado preguntaría sobre el sesgo en los conjuntos de datos de entrenamiento. Cuando hable con proveedores de datos de capacitación, hable sobre el sesgo de los datos y cómo se las arreglan para eliminar el sesgo en los conjuntos de datos que generan o adquieren. Si bien es de sentido común que es difícil eliminar el sesgo por completo, aún puede conocer las mejores prácticas que siguen para mantener a raya el sesgo.

¿Son escalables?

Los entregables únicos son buenos. Los entregables a largo plazo son mejores. Sin embargo, las mejores colaboraciones son aquellas que respaldan sus visiones comerciales y, al mismo tiempo, escalan sus entregables con su creciente

• Requisitos.

Por lo tanto, analice si los proveedores con los que está hablando pueden escalar en términos de volumen de datos si surge la necesidad. Y si pueden, cómo cambiará la estrategia de precios en consecuencia.

Conclusión

¿Quieres conocer un atajo para encontrar el mejor proveedor de datos de entrenamiento de IA? Póngase en contacto con nosotros. Omita todos estos tediosos procesos y trabaje con nosotros para obtener los conjuntos de datos más precisos y de mayor calidad para sus modelos de IA.

Marcamos todas las casillas que hemos discutido hasta ahora. Habiendo sido pioneros en este espacio, sabemos lo que se necesita para construir y escalar un modelo de IA y cómo los datos están en el centro de todo.

También creemos que la Guía del comprador fue extensa e ingeniosa de diferentes maneras. El entrenamiento de IA es complicado, pero con estas sugerencias y recomendaciones, puede hacerlas menos tediosas. Al final, su producto es el único elemento que finalmente se beneficiará de todo esto.

No estas de acuerdo